Medtem ko se nevladne organizacije in strokovnjaki borijo za mednarodno prepoved avtonomnega orožja, ki mu pogosto pravijo kar ubijalski roboti, sodelovanje univerz in orožarske industrije pri njegovem razvoju kaže, da je širjenje umetne inteligence na področje vojaške tehnologije postalo mainstream.

Velika verjetnost, da bodo stroji nekoč sami izbirali človeške tarče, po mnenju nevladnih organizacij odpira etična vprašanja, hkrati pa postavlja pod vprašaj temelje človekovih pravic, mednarodnega prava in neproliferacije. Iz teh in drugih razlogov mnoge organizacije in posamezniki pozivajo k uvedbi preventivne prepovedi razvoja, proizvodnje in uporabe avtonomnega orožja.

Naraščanje interesa

Prihodnji teden bo minilo pet let, odkar so v okviru Organizacije združenih narodov začeli razpravljati o tovrstnem orožju kot grožnji za mednarodno varnost. V ponedeljek se bo v Ženevi med zasedanjem držav podpisnic mednarodne konvencije o konvencionalnem orožju (CCW) že drugič sestala posebna delovna skupina vladnih strokovnjakov, katere naloga je ustvariti podlago za sprejetje novega protokola CCW o avtonomnem orožju. Interes za reševanje problema od leta 2013 narašča, a kaj, ko tehnologija, ki bi jo radi prepovedali, napreduje bistveno hitreje, kot se je mednarodna skupnost sposobna odzivati nanjo.

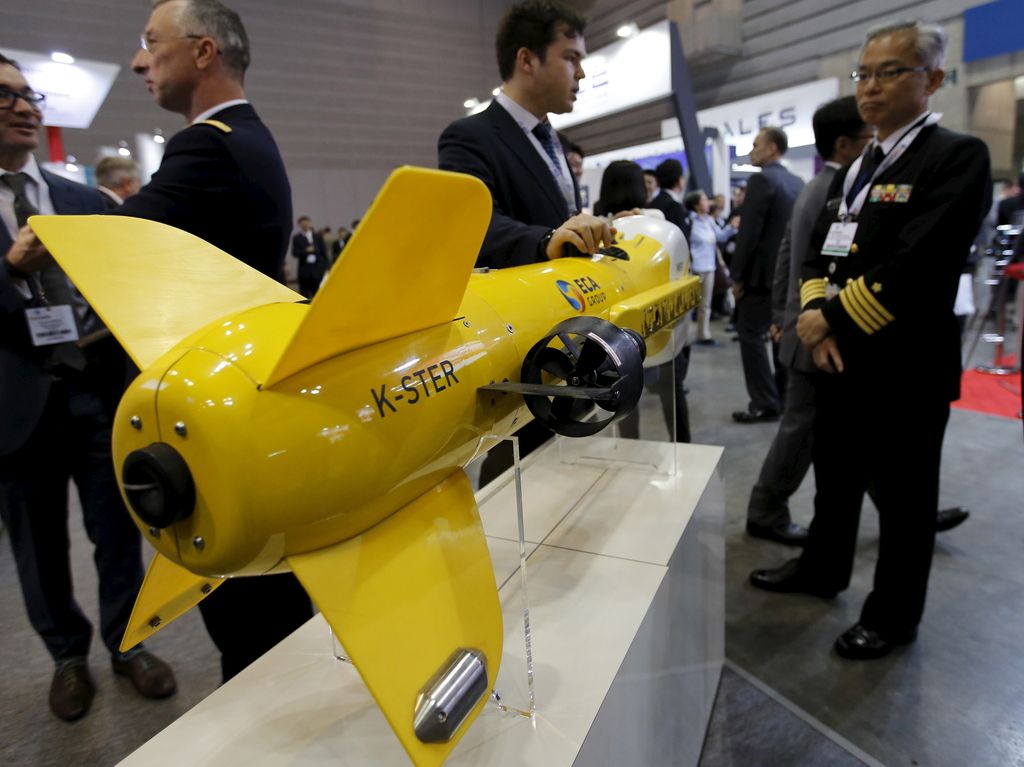

Predhodnike »ubijalskih robotov« po podatkih organizacije Human Rights Watch razvijajo in uporabljajo na Kitajskem, v Izraelu, Rusiji, Južni Koreji, Združenih državah Amerike in Združenem kraljestvu. Pri tem jim pomagajo tudi iz akademskih vrst, kot kaže napovedano sodelovanje med korejskim naprednim znanstvenim in tehnološkim inštitutom (Kaist) ter podjetjem Hanwha Systems, enim največjih proizvajalcev orožja v Južni Koreji.

Poziv k bojkotu

Skupina akademikov iz skoraj 30 različnih držav je v odprtem pismu pozvala k bojkotu sodelovanja z eno najuglednejših univerz v Aziji, dokler njeno vodstvo ne bo podalo ustreznih zagotovil, da Kaist ne bo sodeloval pri razvoju avtonomnega orožja.

»V času, ko se v Združenih narodih pogovarjajo, kako bi omejili grožnjo tovrstnega orožja za mednarodno varnost, je obžalovanja vredno, da si ugledna institucija, kakršna je Kaist, želi pospešiti tekmo za njegov razvoj,« so v pismu zapisali raziskovalci umetne inteligence in robotike iz vsega sveta, med njimi sta tudi Slovenca, profesor Ivan Bratko z ljubljanske fakultete za računalništvo in informatiko ter profesor Matjaž Gams z Instituta Jožef Stefan.

Čeprav se je predsednik univerze Song Čol Šin hitro odzval na pismo in zavrnil očitke, da Kaist oziroma njegov »raziskovalni center za konvergenco nacionalne obrambe in umetne inteligence« sodeluje pri razvoju kakršnegakoli smrtonosnega avtonomnega orožja, senca dvoma z njegovega partnerstva z znanim proizvajalcem orožja najbrž ne bo kmalu izginila.

Univerza se je po pisanju Guardiana še pred časom hvalila, kako bo raziskovalni center, ki so ga odprli konec februarja, »trdna podlaga za razvoj nacionalne obrambne tehnologije«. V nedavno izbrisani napovedi sodelovanja je vodstvo Kaista med drugim zapisalo, da bo raziskovalni center usmerjen v uporabo umetne inteligence pri razvoju navigacijskih algoritmov, sistemov sledenja in tehnologije prepoznavanja. Nič večjega zaupanja v projekt ne zbuja dejstvo, da so med proizvodi podjetja Hanwha Systems tudi kasetne bombe, prepovedane v 118 državah.

Tretja revolucija

»Če bo razvito, bo avtonomno orožje tretja revolucija v vojskovanju,« so v odprtem pismu posvarili akademiki. Vojne bodo po njihovih besedah potekale bistveno hitreje, po obsegu pa bodo večje kot kdaj prej. »Avtonomno orožje lahko postane tudi orožje terorja. Despoti in teroristi bi ga lahko uporabili proti nedolžnim populacijam, ob tem pa pozabili na etične zadržke.«

V vsakem primeru, so bili jasni, je to Pandorina skrinjica, ki bi morala ostati zaprta. Prepričani so, da se lahko pri avtonomnem orožju, »tako kot pri nekaterih drugih tehnologijah, ki so bile prepovedane v preteklosti«, človeštvo preprosto odloči, da ga ne bo razvilo.

Pa je odločitev res tako preprosta? Če ne drugega, bo čedalje težja, sploh za države, ki bodo prve razvile tovrstno orožje, pri katerem bo človek imel zgolj postransko vlogo. Znanstveniki bodo ta proces z novimi odkritji hote ali nehote še pospešili.

Tiskane izdaje

Tiskane izdaje