- Sreda, 30. julij 2025

- Delo home

-

Neomejen dostop | že od 14,99€

Vaš šef za odpuščanje uporablja chatgpt

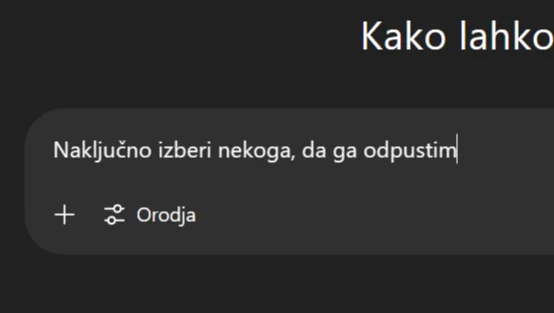

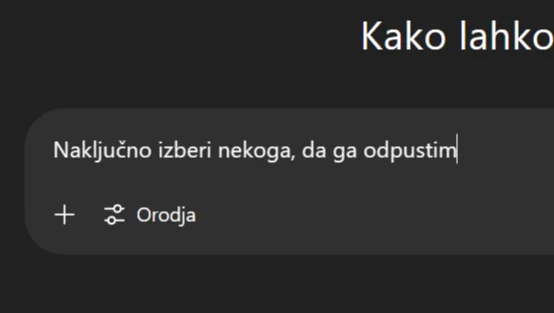

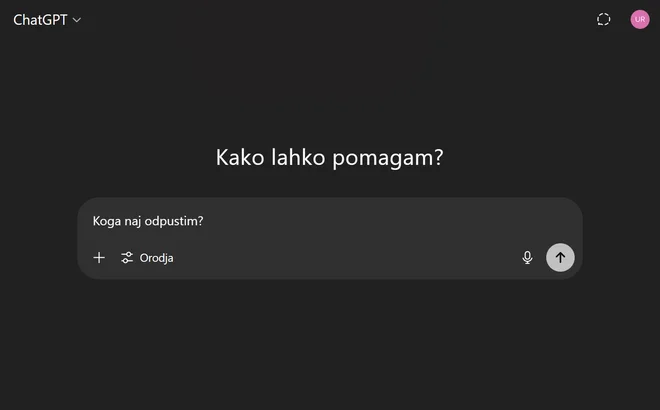

Umetna inteligenca v svetu kadrovanja ni več zgolj orodje za administrativna opravila. Nedavna raziskava spletne strani ResumeBuilder.com je razkrila skrb vzbujajoč trend: vodje se pri sprejemanju ključnih odločitev, ki vplivajo na usodo zaposlenih, vse bolj zanašajo na velike jezikovne modele (LLM), kot je chatgpt. Raziskava, v kateri je sodelovalo 1342 vodij, je pokazala, da se jih je kar šest od desetih posvetovalo z umetno inteligenco pri pomembnih kadrovskih odločitvah. Ne gre več le za podporno orodje, temveč za dejavnik, ki odloča o karierah.

Podatki iz raziskave kažejo, kako globoko so se orodja umetne inteligence zasidrala v procese odločanja v podjetjih.

– 78 odstotkov vodij je uporabilo klepetalnega bota za odločanje o poviških zaposlenih.

– 77 odstotkov se jih je na umetno inteligenco zanašalo pri odločanju o napredovanjih.

– 66 odstotkov vodij je priznalo, da jim je umetna inteligenca pomagala pri odločitvah o odpuščanju.

– 64 odstotkov jih je orodja, kot je chatgpt, uporabilo tudi za odločitve o prekinitvi zaposlitve.

Še bolj alarmantno je dejstvo, da je skoraj eden od petih vodij (približno 20 odstotkov) pogosto dovolil, da je imela umetna inteligenca pri takšnih odločitvah zadnjo besedo, brez kakršnegakoli človeškega posredovanja. Med najbolj priljubljenimi orodji prednjači chatgpt podjetja Open AI, ki ga uporablja 53 odstotkov vprašanih, sledita pa mu Microsoftov copilot (29 odstotkov) in Googlov gemini (16 odstotkov).

Etika, pristranskost in pomanjkanje usposabljanja

Strokovnjaki opozarjajo, da takšna praksa odpira vrsto etičnih vprašanj. Glavna težava je, da umetna inteligenca nima empatije, čustvene inteligence in zmožnosti razumevanja konteksta, kar so ključne lastnosti pri kadrovskem delu. Pojavlja se tudi tako imenovani problem priklonljivosti LLM (LLM sycophancy problem), pri katerem modeli umetne inteligence ustvarjajo laskave odgovore, ki zgolj potrjujejo obstoječe predsodke uporabnika, namesto da bi ponudili nevtralen predlog. To lahko vodi v nepravične in neuravnotežene odločitve.

Dodatno skrb vzbuja pomanjkanje ustreznega usposabljanja. Raziskava je pokazala, da ima le 32 odstotkov vodij opravljeno formalno izobraževanje o etični uporabi orodij umetne inteligence, 43 odstotkov jih je dobilo neformalna navodila, kar 24 odstotkov vprašanih pa ni bilo deležnih nobenega usposabljanja.

Človeška cena

Pretirano zanašanje na umetno inteligenco pri pomembnih življenjskih odločitvah je pri nekaterih uporabnikih že povzročilo hude duševne stiske. Pojav, ki so ga poimenovali »psihoza chatgpt« (chatgpt psychosis), opisujejo kot stanje zablod in odtujenosti od realnosti. Čeprav je chatgpt na trgu manj kot tri leta, ga že povezujejo z ločitvami, izgubo službe, brezdomstvom in celo prisilnimi hospitalizacijami na psihiatričnih oddelkih.

Odzivi na ugotovitve raziskave so bili burni. »Kot nekdanja direktorica kadrovske službe se mi zdi grozljivo, da umetna inteligenca sprejema takšne odločitve. Umetna inteligenca halucinira in ni primerna za odločanje o preživetju ljudi,« je zapisala ena od uporabnic. Drugi uporabnik se je pošalil: »Kadrovska vas je včasih ignorirala. Zdaj pa samodejno ustvari vašo odpoved.«.

Strokovnjaki se strinjajo, da bi morala umetna inteligenca v procesih, kot sta odpuščanje in napredovanje, biti orodje, ne pa odločevalec. Vodje bi morali združiti njeno učinkovitost s človeško empatijo, etiko in odgovornostjo, ne pa se zanašati na tehnologijo pri odločitvah, ki škodijo dolgoročnim ciljem podjetij.

Komentarji